Secondo quanto riportato da Bleepingcomputer, la società Flare avrebbe individuato oltre 200.000 credenziali di OpenAI in vendita sul dark web. Se la notizia fosse vera, rappresenterebbe una vulnerabilità importante per moltissime persone e organizzazioni che non hanno aggiornato le proprie best practices, vietando l’utilizzo del servizio di OpenAI.

Quando non vietata, la Chatbot di OpenAI viene utilizzata per l’ottimizzazione del lavoro, fosse anche solo per velocizzare le comunicazioni interne. Ma questa pratica rappresenta per gli attori malevoli un patrimonio da utilizzare per compiere attacchi mirati, oltre a rappresentare una condivisione gratuita delle informazioni con OpenAI. Bisogna considerare, infatti, che la memorizzazione dei contenuti degli scambi tra utente e macchina è una delle impostazioni predefinite di ChatGPT.

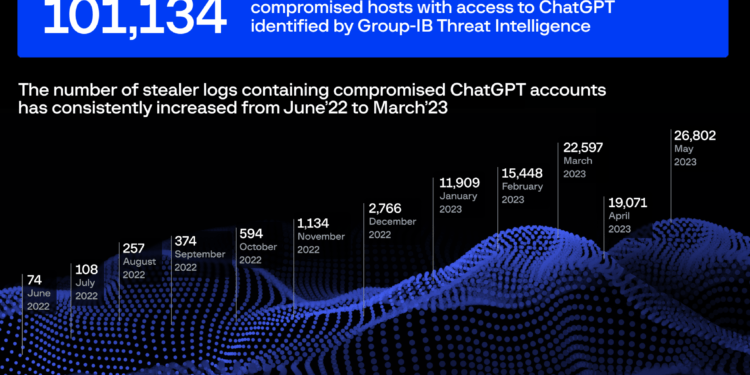

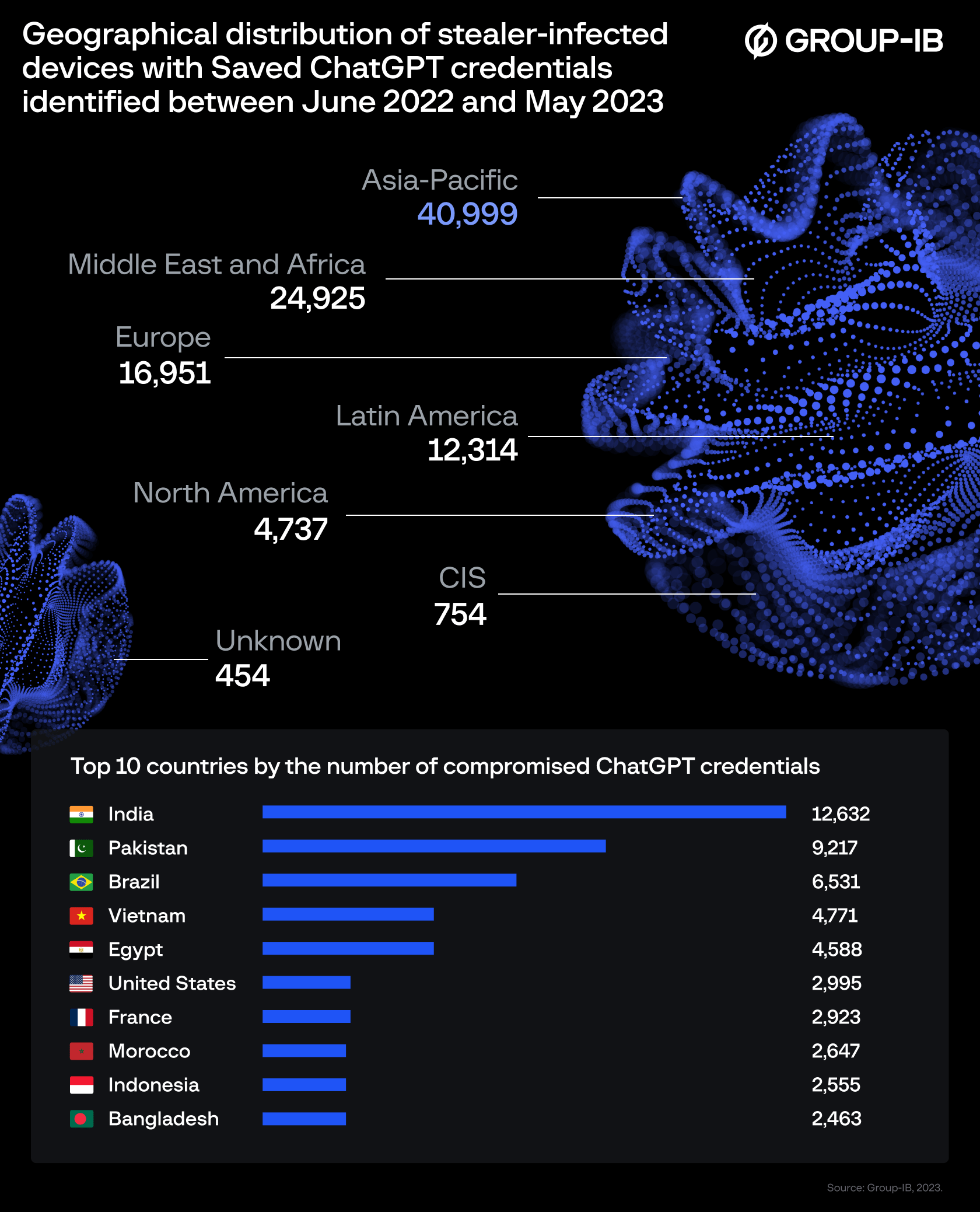

Nonostante non venga dato un grande risalto mediatico al fenomeno, l’interesse degli attori malevoli per gli account di ChatGPT non è una novità. Group-IB ha dichiarato di aver individuato informazioni riguardanti transazioni di diverse centinaia di migliaia di credenziali, la maggior parte delle quali riconducibili ad account dell’aerea dell’Asia Pacifico.

Il prossimo futuro ci darà un’idea più chiara su come il Cybercrimine si evolverà con l’avvento delle macchine dotate di Intelligenza Artificiale, ma quanto sta accadendo ci ricorda, per l’ennesima volta, una lezione importante: l’innovazione tecnologica comporta dei rischi. Forse, prima di dare il via alla prossima rivoluzione tecnica, sarebbe bene aprire un dibattito pubblico, considerare l’ambiente in cui si introduce, lee possibili conseguenze, le vulnerabilità e quali misure adottare per non esporre le comunità a grandi pericoli.